Исследователи из OpenAI представили научную работу, объясняющую природу возникновения «галлюцинаций» крупных языковых моделей, включая ChatGPT. Речь идет о ситуации, когда система уверенно выдает ложную информацию. Ученые утверждают, что такая проблема возникает не случайно и даже невозможно устранить ее окончательно путем улучшения методов обучения нейронных сетей. Об этом сообщает Science Alert.

Исследование показало, что механизм формирования ответов большими языками моделями подразумевает постепенное построение предложений слово за словом, основываясь на вероятностных расчетах. Это неизбежно ведет к накоплению ошибок при формировании длинных последовательностей текста. Даже при идеальной тренировочной выборке остаются области неопределенности, приводящие к ошибкам.

Более того, авторы обнаружили зависимость частоты появления неверных фактов от редкости конкретных сведений в процессе тренировки модели. Например, если около 20% дат рождений известных людей встречаются лишь однажды в тренировочных данных, вероятность неправильного ответа на запросы относительно их дня рождения достигает тех же 20%.

Еще одна важная причина устойчивости этой проблемы связана с принципами оценки качества современных систем искусственного интеллекта. Большинство существующих тестов и рейтингов используют бинарную систему оценивания, при которой неправильные ответы и неуверенность («не знаю») получают одинаковый нулевой балл. Таким образом, стратегии оценки стимулируют уверенность, независимо от правильности ответа.

Предложенный учеными способ исправления заключается в изменении подхода к оценке результатов работы нейросетей. Модель должна учитывать собственную степень уверенности перед выдачей ответа, а тестовые системы должны вознаграждать отказ от недостоверных утверждений. Однако внедрение подобной схемы значительно снизит скорость обработки запросов и повысит вычислительные затраты, делая процесс экономически менее привлекательным для разработчиков массовых приложений.

В общем, несмотря на наличие технических решений, устранение «галлюцинаций» сталкивается с серьезными экономическими препятствиями. По мнению авторов исследования, пока бизнес-модели потребительских сервисов будут требовать быстрых и уверенных ответов, ошибка продолжит возникать при функционировании большинства популярных чат-ботов.

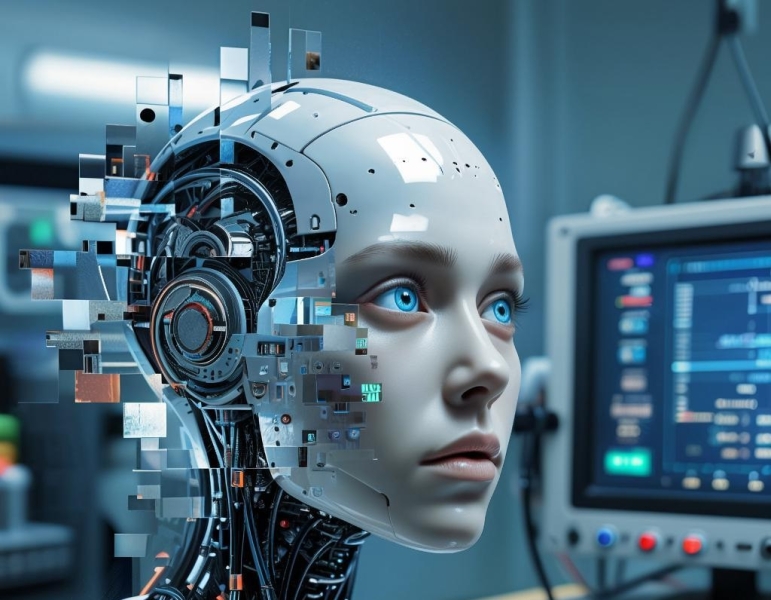

| Нуждается ли искусственный интеллект в физическом воплощении для достижения человеческого уровня интеллекта? |

Наука и технологии Наука и технологии Китай испытал дрон необычной формы, похожий на НЛО 29.08.2025 692

Невероятную сцену наблюдали в Китае: над полями для испытаний поднимался вертикально вверх летательный аппарат, словно неземной объект, появившийся из глубин космоса.

Ученые создали новый способ коррекции зрения без хирургического вмешательства 21.08.2025 401 Китайская компания разрабатывает робота для вынашивания детей 16.08.2025 346 Когда искусственному интеллекту приходится брать кредит 05.09.2025 276 Лёд способен генерировать электричество, обнаружили ученые 07.09.2025 233 ПОСЛЕДНИЕ НОВОСТИ Наука и технологии Эксперты объяснили, почему сложно устранить «галлюцинации» у ИИ 17.09.2025 30

Исследователи из OpenAI представили научную работу, объясняющую природу возникновения..

Ближайшая внеземная цивилизация может находиться на противоположной стороне Галактики, считают ученые 17.09.2025 Реформа календаря Цезаря: хроника самого длинного года в истории 16.09.2025 Разные новости Учёные впервые создали полную цифровую модель мозга живого существа 16.09.2025 80

Учёные завершили работу по созданию цифровой модели мозга круглого червя Caenorhabditis..

В Египте археологи обнаружили древний медеплавильный комплекс эпохи фараонов 15.09.2025 Астероид Рюгу является фрагментом древнего тела, содержащего огромное количество воды 15.09.2025